“大模型开发与赋能”重磅讲习班开课啦!线下名额150人!免费参加!

2023-07-20 16:25:08

人工智能已进入“大模型”时代,这一浪潮正以突飞猛进之势演变变革着现代科技与行业领域创新发展的范式,然而“大模型”背后的关键要素复杂多变使得前沿领域研究与产业应用门槛陡然上升……

琶洲实验室(黄埔)长期关注人工智能算法领域的研究,成立AI模型算法中心,汇聚了人工智能领域方面领军人才,在大模型领域产出了大量原创成果。为了推广大模型应用,降低大模型在行业应用中的门槛,琶洲实验室(黄埔)将于8月1日—8月4日开展“大模型开发与赋能”主题讲习班,邀请相关领域一线专家,面向一般研究者、工程师以及相关领域从业者,采用贯穿大模型各环节的方式展开内容讲解,从数据准备、模型机理、算法构建、算力配备等角度循序渐进讲解大模型。

我们期待通过此次讲习班,帮助更多从业人士了解大模型内在运行机理,初步掌握大模型不同程度的使用方法,尝试从不同角度回答如何为大模型准备数据、如何开发和使用大模型、如何训练大模型以及如何让大模型赋能应用等重要问题。

我们期待通过此次讲习班,能够启发企业工程师把握调制领域专属大模型的技术方法,帮助不同行业人员把握大模型时代契机,从研究基础、技术水平以及行业应用等不同层面从这一轮大模型潮流中获得赋能与发展。

现诚挚邀请广大算法从业者、爱好者朋友们参加!

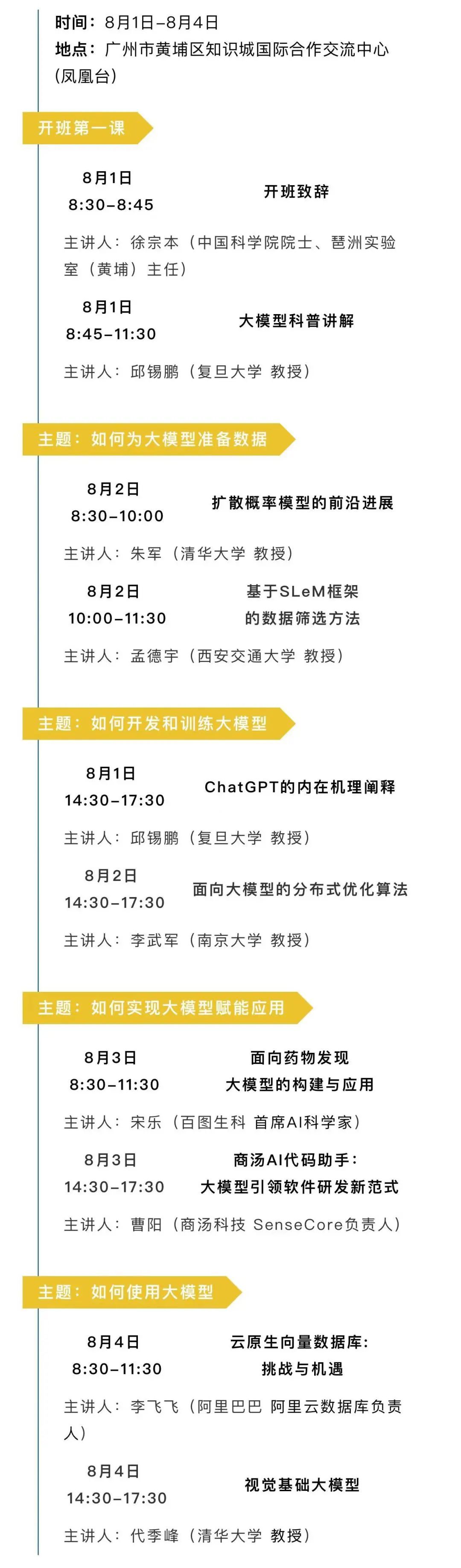

“大模型开发与赋能”讲习班日程安排

课程介绍

LESSON 1 大模型科普讲解

讲座摘要:

课程旨在帮助学员理解和掌握大规模深度学习模型,如GPT等的基础知识和应用方法。课程将通过深入浅出的方式,科普深度学习、自然语言处理、神经网络等基础概念,让学员理解这些大模型的工作原理、训练方法和应用领域。此外,课程还将探讨这些模型的优点、限制以及未来发展趋势。通过本课程,学员将了解到大模型如何改变了我们的生活,并学习如何利用这些工具来解决实际问题。同时,我们将引导学员探索和思考大模型的潜在影响,以及如何在应用大模型时兼顾道德和可持续性的问题。

讲座大纲:

1. 引言

1.1 人工智能、机器学习和深度学习的基础知识

1.2 大模型的概述和历史发展

2. 深度学习基础

2.1 神经网络及其工作原理

2.3 神经网络优化算法

3. 自然语言处理与语言模型

3.1 自然语言处理简介

3.2 语言模型

4. Transformer 和自注意力机制

4.1 Transformer 模型介绍

4.2 自注意力机制的原理

5. 大模型介绍

5.1 大语言模型原理

5.2 多模态大模型

5.3 大模型的实际应用示例

6. 大模型的优点和局限性

6.1 大模型的优势和贡献

6.2 大模型的挑战和限制

7. 大模型的未来

7.1 未来的趋势和展望

7.2 可持续性和道德考量

LESSON 2 ChatGPT的内在机理阐释

讲座摘要:

课程将向学员阐述如何开发大模型从而获得深入理解其内在机理。我们将涵盖从准备数据,预处理,模型架构,训练,微调,到后处理和评估的全过程。这门课程不仅将聚焦在ChatGPT的原理和开发过程,同时也会涉及到一些更高级的主题,如如何调优模型以适应特定任务。这门课程的目标是让 学员掌握深度学习模型ChatGPT的开发,并理解它在各种实际应用中的表现和可能的影响。

课程大纲:

1. 引言:ChatGPT的历史和应用

1.1 ChatGPT的历史和演变

1.2 ChatGPT的应用范围及其影响

2. 模型架构和原理

2.1 理解Transformer架构

2.2 GPT的特性和优势

2.3 GPT的潜在限制和挑战

3. 数据准备和预处理

3.1 选择和获取适合的训练数据

3.2 数据清洗和预处理

3.3 用于训练ChatGPT的特定数据格式

4. 训练和微调

4.1 理解训练过程中的损失函数和优化器

4.2 使用GPU和分布式训练

4.3 模型微调的技术和策略

5. 后处理和评估

5.1 生成和解码策略(如Greedy, Beam Search, Top-K, Top-P等)

5.2 评估ChatGPT模型的技术和指标

5.3 理解模型误差的来源

6. 调优和任务适应

6.1 如何调优模型以适应特定任务

6.2 理解和应用迁移学习

6.3 用于特定任务的微调策略

邱锡鹏,复旦大学计算机学院教授,担任中国中文信息学会理事、上海市计算机学会自然语言处理专委会主任等,主要研究方向为自然语言处理基础技术和基础模型,发表CCF A/B类论文80余篇,被引用1万余次,入选 “爱思唯尔2022中国高被引学者”。获得ACL 2017杰出论文奖(CCF A类)、CCL 2019最佳论文奖、《中国科学:技术科学》2021年度高影响力论文奖,有5篇论文入选ACL/EMNLP等会议的最有影响力论文,主持开发了开源框架FudanNLP和FastNLP,已被国内外数百家单位使用,发布了MOSS、CPT、BART-Chinese等中文预训练模型,在中文模型中下载量排名前列。曾获中国科协青年人才托举工程项目、国家优青 项目、科技创新2030“新一代人工智能”重大项目课题等,2020年获第四届上海高校青年教师教学竞赛优等奖,2021年获首届上海市计算机学会教学成果奖一等奖(第一完成人),2022年获钱伟长中文信息处理科学技术奖一等奖(第一完成人)。

LESSON 3 扩散概率模型的前沿进展

讲座摘要:

AIGC发展迅速,扩散概率模型是AIGC的关键技术之一,在跨模态的文图生成、3D生成等方面取得显著进展。该报告将介绍扩散概率模型的若干进展,包括扩散概率模型的基础理论和高效算法、大规模多模态扩散模型以及文到3D生成等内容。

朱军,清华大学计算机系Bosch AI教授、IEEE Fellow,清华大学人工智能研究院副院长,曾任卡内基梅隆大学兼职教授。2001-2009年获清华大学学士和博士学位,主要从事机器学习研究,担任国际著名期刊IEEE TPAMI的副主编,担任ICML、NeurIPS、ICLR等资深领域主席和最佳论文评审委员20余次。获中国科协求是杰出青年奖、科学探索奖、中国计算机学会自然科学一等奖、吴文俊人工智能自然科学一等奖、ICLR国际会议杰出论文奖等,入选万人计划领军人才、中国计算机学会青年科学家、MIT TR35中国先锋者等。

LESSON 4 基于SLeM框架的数据筛选方法

讲座摘要:

现有深度学习方法的有效性依赖于对训练数据集的高质量要求,当训练集呈现蕴含复杂标记噪声、类别不均衡等数据偏差问题时,其有效性往往不能得以保证,这被称之为深度学习的鲁棒性学习问题。这一问题已经严重制约了深度学习在现实场景中的有效应用,是领域亟需面对的瓶颈问题。

本次讲座针对样本筛选这一类典型的处理数据偏差的方法论展开讨论,介绍该方法论从针对少量数据偏差类型的传统手工赋权设定方法,如何演进到更为前沿的大模型背景下针对更多数据偏差类型的自动化赋权方法。特别地,将深入讨论在该方法论背后蕴含的元学习思想本质,挖掘其有效性理论内涵,从而揭示其可能对现实场景中复杂鲁棒深度学习问题的潜在泛化可用性。

孟德宇,西安交通大学数学与统计学院教授,博士生导师,聚焦于机器学习基础理论与算法研究。曾获陕西省科学技术一等奖(第一获奖人),陕西省青年科技奖,入选长江学者特聘教授,中组部青年拔尖人才计划。发表IEEE汇刊论文40余篇,计算机学会A类会议40余篇,任IEEE Trans, PAMI,National Science Review,Science China: Information Sciences等7个国内外期刊编委。

LESSON 5 面向大模型的分布式优化算法

讲座摘要:

大模型的训练(也叫学习)面临极大的算力挑战。大模型的训练大都采用基于多机多卡的分布式优化算法(大模型联邦学习可以看成是面向物理分散数据的分布式优化)。分布式优化算法决定了算力利用率。低效分布式优化算法将导致较低的算力利用率,甚至可能导致机器和卡越多、训练速度越慢的结果。高效分布式优化算法能提升算力利用率,将为学术界(算力资源相对受限)研究大模型提供关键支撑,也将为工业界大模型应用的降本增效提供核心技术。

本报告将介绍大模型训练中(包括大模型联邦学习中)的高效分布式优化算法,包括业内主流算法和我们研究组最近提出的算法。

李武军,博士,南京大学计算机系、计算机软件新技术全国重点实验室教授,博导,南京鼓楼医院医学大数据中心主任。研究领域为人工智能、机器学习、大数据与智慧医疗。2020-2023年连续四年入选AI 2000人工智能全球最具影响力学者(或提名)榜单,其中2021年在经典人工智能领域排在全球第8名。在国内外著名人工智能期刊和会议上发表论文60余篇,获授权发明专利10余项,申请发明专利20余项。论文被50余位国内外科学院/工程院院士和200余位AAAI/ACM/IEEE Fellow引用。研究成果被国际著名学者评价为“首个方法”和“先进水平”,并被应用于国家重要部门、头部互联网企业、大型央企和医院。主持国家重点研发计划课题、国家自然科学基金等项目。参与研发阿里巴巴云计算平台(“飞天”),并作为三位作者之一参与编写关于“飞天”的第一本专著。指导的学生获得华为天才少年、阿里星(每年阿里巴巴集团10名左右获得者)、百度奖学金(每年全球共10名获得者)、阿里巴巴全球数学竞赛金牌(年度全球第一)、“互联网+”大学生创新创业大赛金奖和最佳创意奖等荣誉。

LESSON 6 面向药物发现大模型的构建与应用

讲座摘要:

Can we leverage a large amount of unsupervised data models to accelerate target discovery and drug design? In this talk, I will introduce the xTrimo family of large scale and interrelated pretrained models across a multiscale of biological processes, integrating a huge amount of data from protein sequences, structures, protein-protein interactions and single- cell transcriptomics data.

The pretrained mode ls c an be used downstream to address many problems arising from target discovery and drug design. As concrete examples, I will show that xTrimo models are achieving SOTA in drug target combination predictions and antigen-antibody complex structure predictions.

宋乐,博士,百图生科(BioMap)首席AI科学家,著名的机器学习和图深度学习专家,曾任美国佐治亚理工学院计算机学院终身教授、机器学习中心副主任,阿联酋 MBZUAI 机器学习系主任,蚂蚁金服深度学习团队负责人(P10)、阿里巴巴达摩院研究员,国际机器学习大会董事会成员,具有丰富的 AI 算法和工程经验。自 2008 年起,在 CMU 从事生物计算相关的研究,利用机器学习技术对靶点挖掘、药物设计取得了一系列突破性成果,获得 NeurIPS、ICML、AISTATS 等主要机器学习会议的最佳论文奖。社区服务方面,曾担任 NeurIPS、ICML、ICLR、AAAI、IJCAI 等 AI 顶会的领域主席,并出任 ICML 2022 的大会主席,是同行评议期刊JMLR、IEEE TPAMI 的副主编。

LESSON 7 商汤AI代码助手:大模型引领软件研发新范式

讲座摘要:

人工智能大模型的出现,将形成软件开发的新范式。在大模型时代,未来软件的价值将有80%由人工智能大模型提供,20%的比例会由“提示工程”(Promptengineering)和传统业务开发组成。

商汤AI代码助手,是商汤基于NLP大模型研发的AI辅助软件开发产品。通过人工智能大模型与用户反馈闭环的结合,基于人工智能大模型的下一代软件,也会“越用越智能”。

曹阳,商汤科技SenseCore AI大装置平台产品负责人。本科毕业于中国科学技术大学,博士毕业于新加坡国立大学。在AI云、AI平台、计算机视觉、机器学习等方向有丰富的人工智能产业界研究经验。历任商汤科技研究总监、新加坡主权基金投资公司GIC高级副总裁、主任数据科学家、东南亚出行平台Grab经济技术部算法研发负责人等。在TKDE、IJCAI等AI顶级期刊及会议上发表了多篇文章。

LESSON 8 云原生向量数据库: 挑战与机遇

讲座摘要:

在云计算时代,云原生分布式数据库因其弹性扩展、高可用、分布式等特性而获得了大量应用。数据库系统在快速的向云原生化、平台化、一体化、智能化的四化方向演进。随着大模型的快速发展和应用,海量向量数据的高效处理成为一个核心挑战,在面向retrieval plugin、私域数据(知识库)embedding等方向上有广阔的应用。

如何提供一站式一体化的向量数据库能力,提供多维度融合智能查询和搜索面临很多关键挑战和机遇。报告将介绍云原生向量数据库的关键技术和进展,以及云原生数据系统和大模型结合的展望。

李飞飞,ACM Fellow, CCF Fellow,IEEE Fellow。阿里云数据库产品事业部负责人。曾获ACM SIGMOD 2023最佳论文奖,EDBT2022 Test-of-Time Award,IEEE ICDCS 2020最佳论文奖,ACM SoCC 2019最佳论文奖runner up,IEEE ICDE 2014 十年最有影响力论文奖,ACMSIGMOD 2016最佳论文奖、ACM SIGMOD 2015最佳系统演示奖、世界互联网大会2019全球领先科技成果奖、浙江省科技进步一等奖、中国电子学会科技进步一等奖等。担任多个国际及国内一流学术期刊和学术会议的编委、主席,中国计算机学会CCF大数据专家委员会副主任,数据库专业委员会常委。带领团队研发了以云原生数据库PolarDB为核心的云数据库系统,实现了中国数据库市场份额第一,作为国内唯一数据库厂商连续3次进入Gartner全球云数据库市场分析报告领导者象限。

LESSON 9 视觉基础大模型

讲座摘要:

In this tutorial, we delve deep into the burgeoning field of Vision Foundation Models, exploring the underlying architec-ture, innovative pre-training strategies, and the integration of vision-language multi-modal models.

This educational journey begins with an in-depth examination of image backbone networks, the structural pillar for many image analysis algorithms. Participants will gain a comprehensive understanding of the design and operations of backbone architectures like Convolutional Neural Networks and Vision Transformers.

The course then transitions to the heart of model representation learning – pre-training techniques. We will guide attendees through the vast landscape of pre-training strategies that are being leveraged to improve model generalization and performance on vision tasks. This includes discussion on methods such as supervised, unsupervised, and self-supervised learning, as well as the importance of large-scale datasets in pre-training.

The tutorial culminates in an exploration of the state-of-the-art in vision-language multi-modal models. As an exciting domain that fuses vision and natural language processing, we will illuminate how models like VL-BERT, CLIP, and GPT-4 are paving the way towards holistic understanding of the visual and linguistic world. Attendees will gain insights into the design and application of these models, and understand how they are pushing the boundaries in tasks such as image captioning, visual question answering, and more.

Whether you're an aspiring student, a seasoned researcher, or a curious technologist, this tutorial offers a comprehensive overview of the key elements in the design and application of Vision Foundation Models. Engage with us as we unravel the complexities and marvel at the potential of these models to reshape our world.

Join us in this journey as we endeavor to create a brighter future for computer vision, a future that understands not just pixels, but context and semantics.

代季峰,清华大学电子工程系副教授,博士生导师,上海人工智能实验室领军科学家。在2009年和2014年于清华大学自动化系分别获得工学学士和博士学位,博士导师周杰教授。2014年至2019年在微软亚洲研究院视觉组工作,担任首席研究员、研究经理。2019年至2022年在商汤科技研究院工作,担任执行研究总监,二级部门长。2022年7月全职加入清华大学电子工程系。研究兴趣包括计算机视觉、深度学习等。相关领域发表国际期刊、会议文章50余篇,论文总引用2万7千余次。以可变形卷积为代表的多篇论文成为物体识别领域里程碑式的成果,被编入世界一流大学视觉课程讲义,被选入深度学习权威框架PyTorch成为标准算子。连续两年获得物体识别领域权威的COCO比赛冠军,之后历届冠军系统也使用了所提出的算法。提出的算法获得自动驾驶感知领域权威的Waymo 2022竞赛冠军。是顶刊IJCV的编委和顶会NeurIPS 2023, ICCV 2023,CVPR 2023、2021,ECCV 2020的领域主席,ICCV 2019的宣传主席。

会议组织

讲习班召集人

西安交通大学,琶洲实验室(黄埔):徐宗本 院士

程序委员会

琶洲实验室(黄埔):马建华 教授

琶洲实验室(黄埔):张 海 教授

清华大学:朱 军 教授

复旦大学:邱锡鹏 教授

西安交通大学:孟德宇 教授

主办单位

广州市工业和信息化局

琶洲实验室(黄埔)/鹏城实验室广州基地(筹)

支持单位

CSIAM大数据与人工智能专委会

全国大数据专委会

中国计算机学会

中国人工智能学会等

会议注册

1.线下参会

名额有限仅限150人,点击下方链接获取线下参会报名表

注:

参会人员自行承担食宿及交通费用。

线下参会将提供课程培训证书。

2.线上直播

B站直播:粤港澳湾区算法大赛。

腾讯会议ID:见后续推文通知。

持续关注

有关讲习班进一步信息发布请关注实验室主页:http://www.pazhoulab-huangpu.com/

微信公众号:粤港澳大湾区 黄埔 国际算法算例大赛

线下参会地址导航:知识城国际合作交流中心(凤凰台):广东省-广州市-黄埔区-创新大道与凤湖二路交叉口北侧